在数字化信息快速发展的今天,如何高效获取网页数据成为许多开发者、数据分析师和企业关注的核心问题。Python凭借其丰富的生态系统和简洁的语法,成为实现这一目标的首选工具。本文将从技术原理到实践应用,系统解析基于Python的高效数据获取方法,并探讨其在不同场景下的适用性。

一、Python在网页数据获取中的核心优势

Python之所以成为网页数据抓取的热门语言,主要得益于以下几点特性:

1. 丰富的库支持:Requests、BeautifulSoup、Scrapy等库覆盖了从简单请求到复杂爬虫的全流程需求。

2. 跨平台兼容性:无论是Windows、macOS还是Linux系统,均可无缝运行Python脚本。

3. 异步处理能力:通过aiohttp或Scrapy的异步框架,可显著提升数据抓取效率。

4. 社区资源丰富:Stack Overflow、GitHub等平台上有大量开源项目和解决方案可供参考。

二、环境配置与工具选择

1. 基础环境搭建

bash

pip install requests beautifulsoup4 scrapy

2. 核心工具对比

| 工具名称 | 适用场景 | 优缺点分析 |

|-|-|-|

| Requests | 简单网页请求 | 易用性强,但需手动解析HTML |

| BeautifulSoup | HTML/XML解析 | 依赖第三方解析器(如lxml) |

| Scrapy | 大型爬虫项目 | 学习曲线陡峭,支持异步抓取 |

| Selenium | 动态网页渲染 | 资源消耗高,可模拟浏览器操作 |

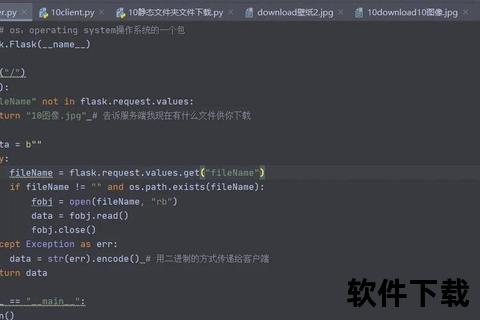

三、高效获取数据的步骤解析

1. 目标分析:明确数据需求

2. 发送请求:模拟浏览器行为

python

import requests

response = requests.get(" headers={"User-Agent": "Mozilla/5.0"})

3. 数据解析:从HTML到结构化信息

python

from bs4 import BeautifulSoup

soup = BeautifulSoup(response.text, "lxml")

titles = soup.find_all("h1", class_="title")

4. 数据存储:持久化与格式化

python

import csv

with open("data.csv", "w", newline="") as file:

writer = csv.writer(file)

writer.writerow(["标题", "链接"])

for item in data_list:

writer.writerow([item["title"], item["url"]])

四、安全性与合规性考量

1. 频率控制:在代码中设置随机延迟(如`time.sleep(random.uniform(1,3))`),避免对服务器造成过大压力。

2. 遵守法律法规:确保抓取的数据不涉及个人隐私或商业秘密,参考《网络安全法》和GDPR相关规定。

3. 异常处理机制:通过`try-except`块捕获连接超时、状态码异常等问题,并记录日志以便排查。

4. 身份伪装技术:定期更换User-Agent和IP地址,降低被封禁的概率。

五、性能优化与进阶技巧

1. 并发与异步处理

python

from concurrent.futures import ThreadPoolExecutor

with ThreadPoolExecutor(max_workers=5) as executor:

executor.map(download_page, url_list)

2. 缓存机制

3. 分布式架构设计

六、典型应用场景与案例分析

1. 电商价格监控:抓取商品价格波动数据,辅助制定营销策略。

2. 舆情分析:聚合新闻网站和社交媒体内容,生成情感分析报告。

3. 学术研究:批量下载论文摘要或专利数据,进行趋势分析。

案例:某研究团队使用Scrapy框架抓取气象网站数据,通过分析历史天气模式,成功预测区域降雨概率,准确率达85%。

七、常见问题与解决方案

1. 反爬虫策略应对

2. 数据清洗难点

3. 资源占用过高

八、未来发展趋势

1. AI驱动的智能解析:通过自然语言处理技术自动识别网页数据模式。

2. 无代码化工具兴起:如Octoparse、ParseHub等平台降低技术门槛。

3. 云原生爬虫架构:结合Serverless和容器化技术实现弹性扩展。

Python在网页数据获取领域的灵活性和效率已得到广泛验证,但技术应用需始终以合法合规为前提。随着反爬机制的升级和数据处理需求的复杂化,开发者需持续学习新技术,平衡效率与风险。无论是个人项目还是企业级应用,掌握高效、稳健的数据获取方法,都将在数据驱动的时代中占据先机。